▹ News : Un nouveau modèle Claude surpuissant.

▹ Zoom : Granola, l'assistant de call ultime ?

▹ Deep Dive : Hallucinations - ça empire, comment limiter les risques ?

Salut à tous,

Il y a un décalage frappant entre ce qui obsède les laboratoires comme OpenAI et Anthropic (l'hypothétique super intelligence) et ce qui préoccupe les gens qui utilisent ces outils au quotidien : la fiabilité.

La confiance ne se décrète pas, elle se construit. Et si la course à la performance continue d'ignorer cette demande de fiabilité, c'est une défiance durable qui s'installe.

En attendant que les modèles progressent enfin sur ce front, il nous faut adopter les bons réflexes. Une exigence urgente dans la mesure où le phénomène des hallucinations tend même à empirer.

Et ça tombe bien : c'est le sujet du sujet central de cette édition.

Bonne lecture !

Sane de Upmynt 💜

🎬 Claude surpuissant. Un brouillon de billet de blog laissé dans un data cache public et non sécurisé a révélé l'existence d'un nouveau modèle baptisé Claude Mythos.

Mythos y est décrit comme « de loin le modèle d'IA le plus puissant jamais développé ».

Anthropic a confirmé la fuite. Ce qu'on sait sur le modèle :

- Il appartient à un nouveau palier baptisé "Capybara" : au-dessus des modèles Opus, plus puissant, mais aussi plus cher à faire tourner.

- Comparé à Claude Opus 4.6, il afficherait des scores "dramatiquement supérieurs" en coding, raisonnement académique et cybersécurité.

- Anthropic juge que ses capacités posent des risques "sans précédent" en matière de cybersécurité.

Le modèle serqit actuellement testé par un petit groupe de clients en avant-première. Pas de date de dispo générale annoncée.

👁️ GPT ads : le carton. OpenAI affirme que son projet pilote américain de publicités ChatGPT dépasse désormais les $100m de revenus annualisés, seulement 6 semaines après son lancement.

Prochains marchés : Canada, NZ et Australie. Pas d'infos sur l'Europe (mais ce sera avant l'été a priori).

✚ Et plus :

- Mistral emprunte $830M pour un immense data center aux portes de Paris (Numerama)

- L’armée française signe un contrat de 3 ans avec Mistral AI pour utiliser ses solutions (L'Usine Nouvelle)

- La Wikipedia anglophone interdit l’édition assistée par IA (Next)

▹ Job à saisir

Mistral recherche son Product manager, AI studio (CDI basé à Paris).

La mission : piloter une plateforme IA entreprise qui permet de passer de prototypes à des systèmes IA en production, en structurant, sécurisant et industrialisant leur usage.

Intéressant car vous êtes au cœur de l’infrastructure IA de demain, avec un rôle stratégique (vision produit + go-to-market) dans LA startup IA la plus ambitieuse d'Europe.

▹ Lien favori

C'est la déclaration par le PDG de Nvidia de l'atteinte de l'AGI qui a le plus suscité votre intérêt (192 clics) : « c'est maintenant ».

▹ Promo Upmynt Entreprise pour vous

Vous êtes nombreux à lire cette newsletter pour garder une longueur d'avance sur l'IA. Mais qu'en est-il du reste de votre équipe ?

Upmynt Entreprise est la solution pensée pour les équipes qui veulent assurer leur veille IA collective sans multiplier les abonnements individuels.

✅ Pour seulement 200€ par an, vous débloquez Upmynt Pro pour toute votre équipe : jusqu'à 20 collaborateurs recevront les éditions intégrales directement dans leur boîte mail.

🤝 Vous rejoindrez de superbes équipes qui ont déjà franchi le pas, comme TF1, Evaneos, Ziggy, Numa ou encore Lalalab.

🎁 Bonus : Pour toute nouvelle souscription à Upmynt Entreprise, recevez en cadeau la 2ème édition de mon ouvrage "Booster votre business avec l'IA" (valeur 22€).

Offre valable jusqu'au 1er avril - Une facture sera générée pour vos notes de frais.

Granola, l'assistant de call ultime ?

Depuis 3 ans, j'ai essayé quantité d'assistants de réunion, en passant de Fireflies à TL;DV puis Fathom.

Mon choix s'est finalement arrêté sur Granola.

De mon point de vue, il surpasse la concurrence. Je vous dis pourquoi.

▹ Pas de bot. Et c'est tout le point.

La plupart des outils de prise de notes IA fonctionnent de la même façon : un bot rejoint votre call visio comme participant, ce qui crée systématiquement un moment gênant (« euh, c'est qui, Fireflies ? »).

Granola fait le choix radical de disparaître. L'outil capte l'audio directement depuis votre machine, sans rejoindre l'appel, sans notification d'enregistrement visible.

Il fonctionne avec n'importe quel logiciel de visio - Zoom, Google Meet, Teams, Webex, et même les appels téléphoniques sur haut-parleur (!).

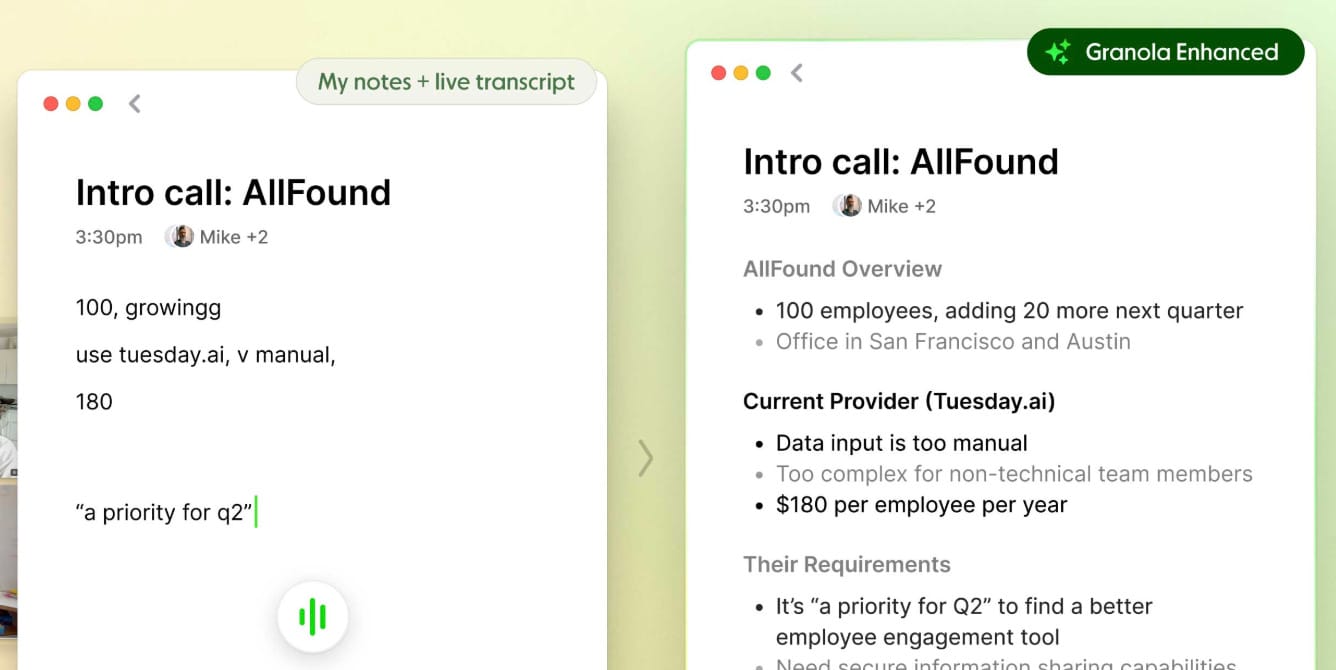

▹ Le vrai différenciateur : la collaboration humain-IA

Ce que je préfère avec Granola : ce n'est pas un simple transcripteur.

Pendant une réunion, j'ai besoin de noter quelques mots-clés ou bullet points pour retenir ce qui me semble important. Je ne souhaite pas tout déléguer à une IA.

C'est mon côté control freak ;)

Une fois un call terminé, l'IA complète mes notes avec un résumé structuré, les actions à mener, les décisions prises et les citations pertinentes - le tout relié à la transcription complète.

Le contenu généré par l'IA apparaît en gris, mes notes originales restent en noir, ce qui permet de distinguer immédiatement ce qui vient de moi et ce que la machine a ajouté.

Ce niveau de collaboration humain-IA est absent des outils de transcription plus simples, qui soit vous donnent tout (écrasant), soit décident pour vous de ce qui est important (en ratant souvent le contexte)

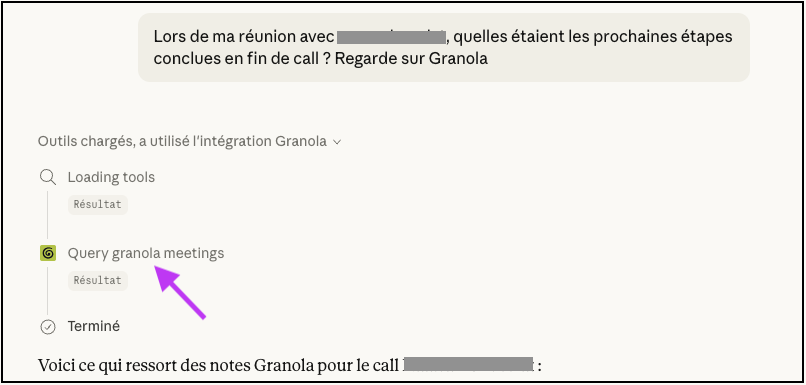

▹ La connexion (MCP) à ChatGPT ou Claude

C'est une nouvelle fonctionnalité (février 2026) qui vient asseoir la supériorité de Granola : le connecteur MCP qui relie vos notes de réunion directement à Claude, ChatGPT, Cursor ou tout autre outil compatible.

Concrètement : vous êtes dans ChatGPT en train de rédiger un document, et vous vous dites "on en a parlé en réunion la semaine dernière" - au lieu de retourner dans Granola chercher la note et copier-coller le passage, l'IA va chercher le contexte directement dans vos conversations. Tellement pratique.

▹ Un outil sûr et compétitif

Côté sécurité, l'outil est conforme SOC 2 et ne permet pas aux modèles tiers d'entraîner leurs IA sur vos données. Pour ceux qui travaillent avec des clients entreprise, c'est un argument qui pèse.

Le plan gratuit de Granola vous donne accès à un nombre illimité de calls (avec 30 jours d'historique). Aucun autre assistant de réunion n'est aussi généreux !

Hallucinations : ça empire ! Comment limiter les risques ?

Dans une enquête récente sur les préoccupations des utilisateurs vis-à-vis de l'IA, un sujet domine tous les autres : la fiabilité.

27% des répondants citent le manque de fiabilité comme leur inquiétude principale. Devant l'emploi, devant la surveillance, devant le risque existentiel.

Et pour cause. Quand votre assistant vous affirme quelque chose avec l'aplomb d'un consultant McKinsey un jour de présentation au Codir, vous avez plutôt envie de le croire.

Le problème, c'est qu'il invente. Régulièrement.

On sait que l'IA peut halluciner, mais on croit (on espère) que le phénomène tend à diminuer.

Las, le problème est intact… Voire il empire.

Alors, comment réduire les dégâts au maximum dans votre usage quotidien ?

▹ Hallucinations : le problème s'aggrave (et ce n'est peut être que le début)

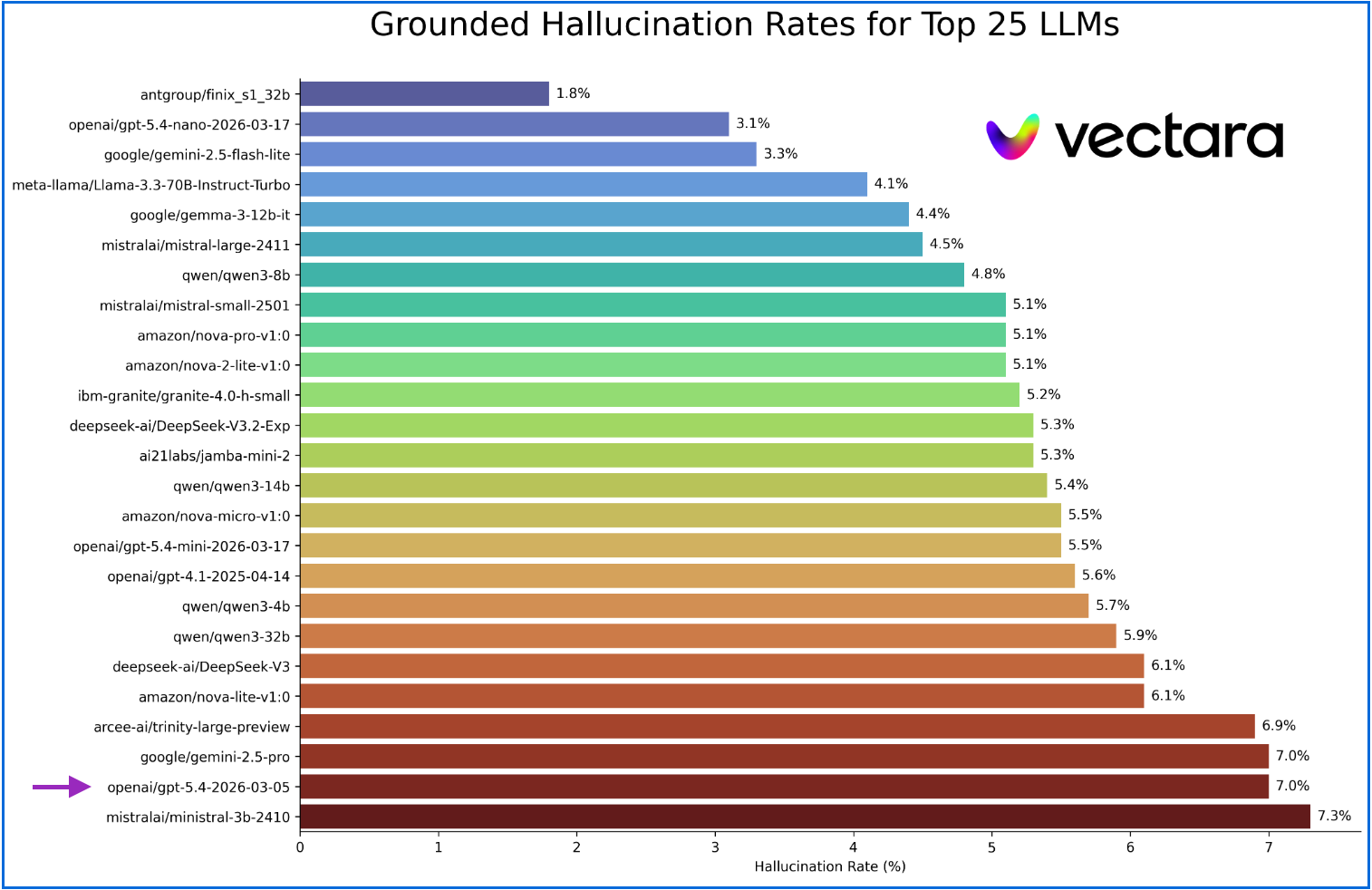

Commençons par les chiffres. Le leaderboard de Vectara, qui mesure le taux d'hallucination "grounded" (sur des tâches de résumé avec source), montre que les meilleurs modèles du marché plafonnent autour de 2 à 5% d'hallucinations, voire plus.

GPT-5.4, le modèle le plus récent d'OpenAI, tout juste sorti ce mois-ci, affiche un décevant taux de 7%.

Le modèle le plus avancé au monde (GPT-5.4) se trompe une fois sur 14.

Et encore, le benchmark Vectara est plutôt clément : on demande au modèle de résumer un texte qu'on lui fournit. Pas de mémoire à mobiliser, pas de raisonnement complexe.

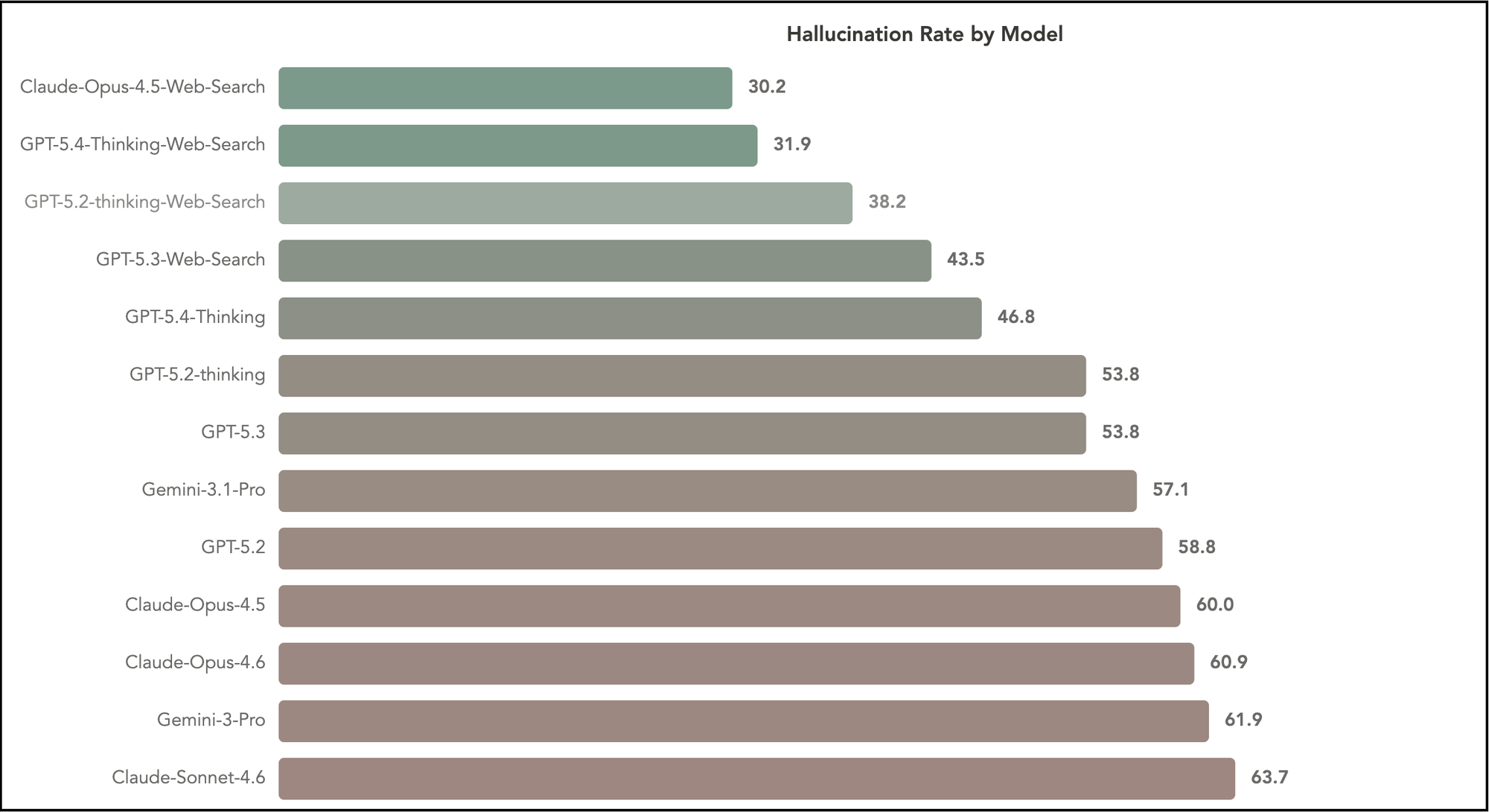

Dès qu'on zoome sur des benchmarks plus exigeants, c'est une autre histoire.

HalluHard, publié en février 2026, teste les modèles sur des questions difficiles en droit, médecine, recherche et code.

Les résultats sont édifiants : les meilleurs modèles du classement, Claude Opus 4.5 et GPT-5.4 affichent un taux d'hallucination au dessus de 30%. 😱

En médical, beaucoup de modèles récents dépassent allègrement les 50%, voire les 80%.

Et pour les sujets d'actualité ? ce n'est pas mieux. L'audit NewsGuard sur les 10 principaux outils IA montre que le taux de publication de fausses informations a presque doublé en un an.

Les modèles relaient désormais des affirmations fausses dans plus d'un tiers des cas sur des sujets d'actualité.

Bref : les hallucinations ne sont pas un problème en voie de résolution. C'est un problème structurel qui stagne, voire empire. ☹️

▹ Bien plus grave que de "simples" erreurs factuelles

Quand on parle d'hallucinations, on pense spontanément aux erreurs grossières : une date inventée, une source fictive, un chiffre sorti de nulle part.

Le problème est en réalité plus profond et plus insidieux.

Rappelons ce que sont les LLM : des modèles probabilistes. Leur job, c'est de prédire le mot suivant. Pas de comprendre. Pas de vérifier. Pas de raisonner au sens où vous et moi raisonnons.

⚙️ Ils extraient des patterns statistiques à partir de milliards de textes et produisent la suite la plus probable.

Ce fonctionnement engendre des biais structurels qui, sans être des hallucinations au sens strict, produisent des réponses trompeuses au quotidien :

- Biais de confiance : L'IA affirme avec le même degré d'assurance une donnée vérifiée et une donnée inventée. Elle ne signale jamais ses zones d'incertitude. Quand elle ne sait pas, elle ne dit pas « je ne sais pas », elle produit une réponse fluide et convaincante quand même.

- Biais d'optimisme : L'angle positif est choisi par défaut. L'IA est structurellement orientée vers l'action, vers le « oui c'est possible » (Hassen Cehef, si tu nous regardes…), vers la recommandation enthousiaste. Demandez-lui d'analyser un investissement risqué : il y a de bonnes chances qu'elle vous encourage à foncer.

- Le biais de conformité (flagornerie) : L'IA tend à aller dans le sens de ce que votre prompt suggère. Si votre question contient implicitement la réponse que vous attendez, votre assistant va probablement la confirmer. Des recherches publiées dans Nature montrent que les LLM peuvent parfaitement connaître la bonne réponse et néanmoins s'aligner sur votre croyance incorrecte pour vous être agréables.

Concrètement, ces biais signifient que même quand l'IA ne fabrique pas de faux fait, elle peut vous induire en erreur par son ton (trop affirmatif), son angle (trop optimiste), son cadrage (trop simple) ou sa complaisance (trop alignée sur vos attentes).

▹ Comment réduire les hallucinations (et les biais) au maximum